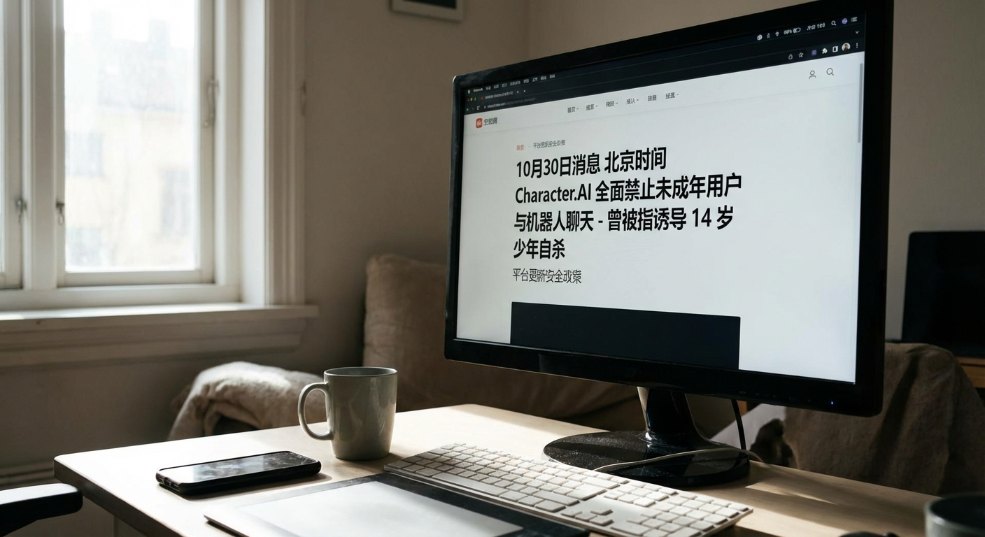

10 月 30 日消息,北京时间今日,聊天机器人平台 Character.AI 宣布,将针对青少年用户推出多项安全措施,此前公司收到了监管机构、安全专家和家长的反馈。

其中一项关键措施,就是在 11 月 25 日前全面取消未满 18 岁用户的开放式聊天功能。在此之前,Character.AI 表示,未成年用户每天的聊天时间将从两小时起逐步缩短。为了让青少年仍能保持互动,Character.AI 将推出新的创意功能,包括与角色共同制作视频、故事和直播内容。

Character.AI 还表示,将推出自主研发的年龄认证系统,并结合 Persona 等领先第三方工具,确保每位用户只能使用适合其年龄的 Character.AI 功能。

此外,Character.AI 将成立独立非营利的 AI 安全实验室,公司将提供资金支持。实验室将专注于下一代 AI 娱乐功能的安全设计创新,重点探索新型安全技术、加强合作并分享经验。

Character.AI 向受开放式聊天取消影响的青少年用户表示歉意,并承认这是一个重大调整,但公司仍认为此举是正确选择。

据1AI此前报道,美国佛罗里达州一名母亲 Megan Garcia 指控人工智能平台 Character.AI 的聊天机器人导致其 14 岁儿子自杀。联邦法官裁定,谷歌与 Character.AI 必须面对这起诉讼。

声明:内容来源公开的各类媒体平台,若收录的内容侵犯了您的权益,请联系邮箱,本站将第一时间处理。