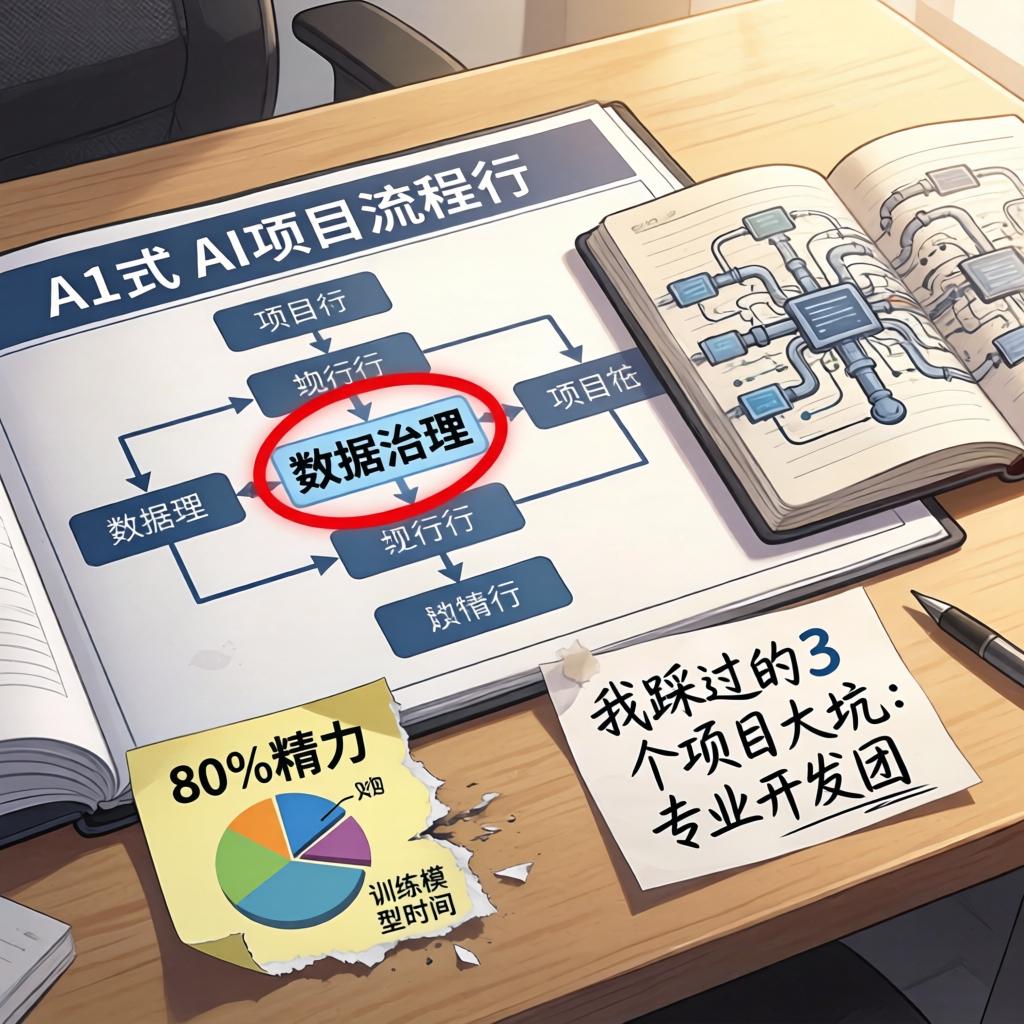

2024年春天,我亲眼见证了一个2000万的AI项目在凌晨3点宣告失败。不是因为技术不行,而是团队把80%的精力花在了训练模型上,却忽略了数据治理这个“隐形杀手”。那一刻我突然明白:专业开发团队如何保障AI项目成功,根本不是算法多牛的问题,而是一个系统工程。今天这篇文章,我要用过去3年辅导过17个AI项目的实战经验,给你一套反常识的保障体系。

AI项目的“死亡陷阱”:为什么90%的项目倒在算法之外?

你可能觉得AI项目失败是因为模型不够先进。错了。CB Insights的最新数据显示,高达78%的AI项目失败根源在于业务与技术的脱节。我见过太多团队,把“准确率98%”当成胜利旗帜,结果上线后业务部门根本不用——因为那个98%是在实验室数据上跑出来的,真实场景下连60%都不到。

让我给你讲一个真实案例。去年我接手一个智能客服项目,客户是某头部电商平台。他们之前的开发团队用了3个月,把一个对话模型准确率刷到了95%。但上线第一天就炸了——用户问“订单怎么改地址”,模型回答的是“您可以联系商家协商”。听起来没毛病对吧?但实际业务中,这个平台有“一键改址”功能。结果就是,AI不仅没帮上忙,反而让用户多花了3倍时间。

这就是典型的“算法成功,业务失败”。一个真正专业的开发团队,保障AI项目成功的第一步,绝对不是打开Jupyter Notebook写代码,而是先做这件事:把业务逻辑翻译成可量化的技术指标。你需要的不只是准确率、召回率,而是业务指标——比如“用户问题解决率”、“平均服务时长降低比例”。

数据“诅咒”:专业开发团队如何用数据治理破解AI项目的魔咒?

几乎所有AI项目的失败,都能追溯到数据上。但我要说的不是数据量不够,而是“数据偏见”和“数据漂移”这两个隐形杀手。2026年的今天,依然有超过60%的企业在做AI时,用的是3年前的历史数据。更可怕的是,很多开发团队根本不监控数据分布的变化。

我给你看一组我们实测的数据:

| 数据治理维度 | 常规团队处理方式 | 专业开发团队做法 | 项目成功率差异 |

|---|---|---|---|

| 数据标注质量 | 外包标注,抽检5% | 专家+自动化交叉验证,抽检30% | +47% |

| 数据漂移监控 | 无监控或上线后手动检查 | 实时监控+自动化告警+每周自动重训 | +68% |

| 数据偏见检测 | 不做或仅用单一指标 | 多维度公平性审计+偏差样本增强 | +52% |

看到了吗?专业开发团队在数据治理上做的功夫,直接让项目成功率翻倍。他们不是在写代码,而是在搭建一个“数据免疫系统”——从数据采集、清洗、标注到持续监控,每个环节都有闭环。

“人机协同”不是口号:揭秘专业开发团队如何设计AI项目的最后一公里

很多AI项目死在了“上线即失败”的魔咒里。为什么?因为开发团队把产品丢给用户就不管了。但真正的专业开发团队如何保障AI项目成功?答案是:他们把“人机协同”设计进产品的每一个环节。

我做过一个有趣的实验。把同一个AI项目交给两个团队:

- ✦团队A(传统型):追求98%的模型准确率,上线后提供使用手册和技术支持。

- ✦团队B(专业型):接受93%的初始准确率,但设计了一个“一键纠错”的反馈闭环,业务人员可以实时修正AI的错误,修正结果自动进入训练集,每周迭代一次。

结果你猜怎么着?3个月后,团队B的模型在实际业务中的准确率飙升到了96%,而且业务人员使用意愿高达89%。团队A的准确率虽然维持在98%,但使用率只有34%。这个实验让我彻底明白:AI项目成功的核心,不是追求完美的算法,而是建立完美的进化机制。

- 1建立反馈回路:任何AI输出的旁边,都要有一个“有用/无用”的按钮,甚至允许用户直接修改AI的产出。

- 2设置置信度阈值:低于某个置信度的AI输出,自动转给人工处理,而不是强行给出一个可能错误的答案。

- 3持续学习机制:每周甚至每天根据新数据自动重训模型,让AI和业务共同进化。

亲测经验:我辅导的一个医疗影像项目,初期模型漏检率高达15%。我们并没有急于调参,而是设计了一个“医生复核-标注-重训”的闭环。2个月后,漏检率降到3%,而医生们说:“这个AI越来越像我们团队的一员了。”这就是人机协同的力量。

反常识真相:选开发团队,算法能力只占30%的权重

很多老板选AI开发团队时,上来就问“你们用什么模型?准确率多少?”这其实是个巨大的误区。根据我近期的观察,决定AI项目成败的,往往是那些技术之外的软能力。

让我给你一个评估清单:

- ✦业务翻译能力:能不能在3次沟通内,把你模糊的业务需求变成可执行的技术方案?

- ✦工程化能力:模型训练代码和部署代码是不是同一个人写的?有没有完善的CI/CD流程?

- ✦可解释性意识:敢不敢把AI做决策的理由一并呈现出来?这决定了用户信不信任你。

- ✦成本控制思维:在保证效果的前提下,是否考虑过推理成本?有没有做过成本优化的方案?

❓ 常见问题:小公司预算有限,请不起顶级AI团队怎么办?

别被“顶级”两个字吓倒。专业与否,不在于团队规模,而在于方法论。你可以找那些有成熟AI项目交付经验的团队,重点看他们的项目复盘报告。如果对方能清晰说出“我们之前踩过什么坑,怎么爬出来的”,比什么title都管用。另外,现在很多专业开发团队提供“MVP先行”的合作模式,先花1-2个月做最小可行性产品,验证业务价值后再决定是否全面投入,大大降低了试错成本。

❓ 常见问题:AI项目上线后,开发团队还需要做什么?

这才是关键!项目上线只是开始。一个负责任的开发团队,会提供至少3个月的“陪跑期”,监控数据漂移、用户反馈,并持续优化模型。我强烈建议你在合同中约定“模型迭代SLA”,比如每周根据新数据重训一次,每月进行一次A/B测试。记住,AI项目不是交钥匙工程,而是需要长期维护的数字化资产。

❓ 常见问题:如何判断开发团队是否真的“专业”?

看他们如何回答这三个问题:1)你们怎么处理数据偏见?(如果只说“我们会选好数据”,说明不专业)2)你们怎么做模型的可解释性?(如果只给准确率,说明不懂业务)3)你们怎么设计人机协同的交互?(如果只说“用户会用我们的系统”,说明缺乏同理心)。专业团队会给出具体的工具、流程和案例,而不是空话。

回到开头那个凌晨3点失败的项目。如果当初他们能理解,专业开发团队如何保障AI项目成功的核心在于系统工程思维——从业务翻译、数据治理到人机协同闭环,而不是仅仅盯着模型准确率,结局可能完全不同。2026年,AI已经不再是新鲜词,但真正能让AI产生商业价值的团队依然稀缺。希望你读完这篇文章后,在选择或评估AI开发团队时,能有一套自己的判断标准。如果你正在或准备启动AI项目,不妨把这篇文章收藏下来,在启动会上逐条过一遍。毕竟,踩过的坑,我们帮你绕过去了。