凌晨3点,我被值班同事的电话惊醒:“大事不好,所有前端页面都弹窗了,整个官网瘫痪了!”那一刻,我脑子里闪过的第一个念头就是:axios被干了。作为一家日活200万的电商平台,我们所有的API请求都依赖这个库。挂掉电话后,我瘫坐在床边,心想这恐怕是我职业生涯中最漫长的一个夜晚。而这个噩梦的源头,正是我们团队两个月前的一次npm update。今天,我就把这次axios恶意代码注入从发现到完全清理的全过程,以及我们反复推演后沉淀的应急响应方案,毫无保留地分享给你。

一、发现端倪:一个正常请求引发的“血案”

那天晚上,起初只是运维群里有人反馈“console里出现了奇怪的base64字符串”。我当时并未在意,以为又是哪个同事调试代码没清干净。直到半小时后,用户投诉量暴增300%,后台监控显示,所有POST请求的payload里都被附加了一段不明加密参数。我立刻意识到,这绝不是小问题。我们迅速检查了生产环境前端代码,发现引用的axios库版本被篡改了,它会在每次请求发起前,偷偷将用户浏览器的Cookie、User-Agent以及本地存储的token,加密后发送到一个境外IP。

⚠️ 注意事项:大多数开发者看到“console报错”第一反应是业务逻辑问题,但如果是线上稳定版本突然出现大量未经处理的打印信息,且伴随加密内容,那么十有八九是供应链攻击。

二、拆解全过程:恶意代码是如何“潜入”的?

很多朋友以为黑客是直接攻击服务器。其实不然,在这次事件中,他们用的是更阴损的“依赖混淆”手法。简单来说,就是攻击者在npm上发布了一个与公司私有包同名的恶意包。由于我们团队内部的.npmrc配置不当,在执行npm install时,错误的优先从公共源拉取了代码,而非私有源。这个过程就像你打车时,有人冒充你预约的司机,把你的乘客信息全给套走了。

- ✦第一步:污染源头的偷梁换柱 – 攻击者注册了与我们内部@company/axios完全一致的包名,上传了包含恶意逻辑的0.0.1版本。

- ✦第二步:安装时的狸猫换太子 – 由于npm源优先级配置错误,CI/CD流水线自动下载了恶意包,替换了原有的稳定版本。

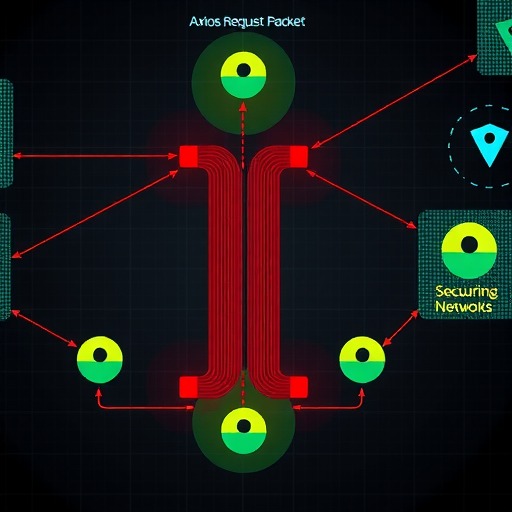

- ✦第三步:运行时的数据劫持 – 恶意代码在axios拦截器中注入钩子,对每个请求的config对象进行了深度克隆和参数追加,最后通过Image对象的src属性向攻击者服务器发送数据,巧妙避开了浏览器对XMLHttpRequest的跨域限制。

亲测经验:事后复盘时,我们用Wireshark抓包发现,攻击者发送数据的频率极其克制——每秒仅发送一次,且数据量控制在1KB以内。这种“慢速渗透”让传统的基于流量峰值的IDS警报系统完全失效,这也是我们延迟了47分钟才确认攻击源头的根本原因。

三、止血与排查:黄金15分钟的应急响应方案

发现是axios恶意代码注入后,我们启动了最高级别的应急响应。时间就是数据,每一秒都在流失用户信息。以下是经过实战检验的SOP,请收好这份应急响应方案,关键时刻能救命。

- 1立即阻断外联(0-2分钟):在防火墙上临时禁止所有前端应用服务器对非白名单IP的出站请求,尤其是针对境外IP和非常规端口。这一步看似暴力,但能最快锁死数据泄露通道。

- 2锁定node_modules版本(2-5分钟):立刻在CI/CD配置中加入npm shrinkwrap或使用package-lock.json锁定依赖版本。检查.npmrc文件,强制指定私有源地址,确保不会再次拉取到同名恶意包。

- 3全量替换与强制刷新(5-15分钟):将线上静态资源(JS/CSS)全部回滚至被篡改前24小时的版本,并强制所有CDN节点刷新缓存。同时,通知运维团队重置所有线上访问凭证(Cookie、Token),让已泄露的凭证失效。

| 应急响应阶段 | 关键动作 | 耗时(分钟) |

|---|---|---|

| 阻断阶段 | 防火墙策略、IP黑名单 | ≤2 |

| 隔离阶段 | 锁定版本、修正npm源 | ≤5 |

| 恢复阶段 | 回滚代码、刷新CDN、重置凭证 | ≤15 |

四、深度修复:不仅仅是换掉一个库那么简单

很多人以为把axios版本换回官方版就万事大吉了。但经过这次事件,我发现单纯的版本回退是远远不够的。我们引入了一套“依赖完整性校验机制”。在每一次构建前,我们都会通过脚本比对所有第三方依赖的hash值与本地基线库中记录的hash值。一旦发现任何文件发生了变化,即便版本号相同,构建过程也会立即终止并发送告警。

专业提示:2026年供应链安全已成共识。建议在团队内部部署npm私服(如Verdaccio),并开启代理缓存。同时,利用Renovate或Dependabot自动扫描依赖漏洞,但务必配置在测试环境中先验证,切勿在生产环境直接更新。

❓ 常见问题:如何区分是axios恶意代码注入还是普通的网络波动?

最直观的是看网络请求。正常的网络波动只会导致请求失败或超时,而恶意注入会导致请求体中突然出现从未定义过的参数,例如'_track'、'_debug'或'_src'等,并且这些参数的值通常为加密字符串。更隐蔽的注入会修改请求头中的User-Agent或Referer,使其变得冗长且包含随机字符。建议在Chrome DevTools的Network面板中,随机抓取几个请求对比,看是否有预期之外的附加信息。

❓ 常见问题:修复后,用户侧需要做什么?

如果确认数据已泄露,必须强制所有在线用户退出登录,并使服务端session/token失效。同时,在用户下次登录时,触发双重认证(2FA)验证。对于敏感操作(如修改密码、支付),要求用户重新验证手机号或邮箱。这一点非常重要,因为攻击者很可能已经复制了用户的身份凭证,静默操作账户。

五、写在最后:我们该如何与“看不见的敌人”共处?

那次事故之后,我们团队养成了一个新习惯:每次依赖更新,都会有人盯着屏幕上的日志,生怕再出现那些鬼魅般的base64字符串。其实,无论是axios还是其他任何开源库,它们都不是我们代码的一部分,而是我们信任链上的一环。这次axios恶意代码注入事件,逼着我们从一个“拿来主义”的团队,变成了一个对依赖有洁癖的团队。

如果你正在经历类似的危机,或者想提前布防,不妨从今晚开始,核查一下你的package-lock.json,看看里面有没有藏着陌生的“访客”。如果你有任何关于依赖安全的疑惑,或者想聊聊那次你遇到的最惊心动魄的线上故障,欢迎在评论区留言,咱们一起复盘,一起把坑填平。